- Author, Thomas Copeland

- Role, BBC Verify

Há 1 minuto

Tempo de leitura: 6 min

Uma onda sem precedentes de desinformação gerada por inteligência artificial (IA) sobre a guerra iniciada por Israel e pelos Estados Unidos contra o Irã tem sido monetizada por criadores de conteúdo online, afirmam especialistas ouvidos pelo BBC Verify, serviço de verificação da BBC.

Os criadores que faturam com esses conteúdos têm acesso crescente a ferramentas de IA generativa que geram textos, sons e imagens que parecem ser criados ou registrados por seres humanos.

A análise feita pelo BBC Verify identificou diversos exemplos de vídeos gerados com ferramentas de IA e imagens de satélite forjadas sendo usados para fazer alegações falsas ou distorcidas sobre o conflito. Esses vídeos, aliás, somam centenas de milhões de visualizações em redes sociais.

"A escala é realmente alarmante, e essa guerra tornou impossível de ignorá-la agora", afirma Timothy Graham, especialista em mídia digital da Universidade de Tecnologia de Queensland, na Austrália.

"O que antes demandava uma produção de vídeo profissional agora pode ser feito em minutos com ferramentas de IA. É basicamente o colapso das barreiras para criar convincentes imagens artificiais de um conflito."

Muitas pessoas recorrem às redes sociais para procurar e compartilhar as últimas informações e tentar entender uma semana de um conflito que evolui rapidamente.

A rede social X (ex-Twitter) anunciou nesta semana que iria suspender temporariamente os criadores do programa de monetização se eles publicarem vídeos do conflito no Oriente Médio gerados por IA sem um rótulo de identificação.

Os programas de monetização de redes sociais pagam os criadores de conteúdos que atraem altos números de visualizações, curtidas, compartilhamentos e comentários com pagamentos na plataforma.

"É um sinal notável de que eles [os responsáveis por essas plataformas] perceberam que isso é um problema imenso", afirma Mahsa Alimardani, pesquisadora especialista em Irã do Instituto de Internet de Oxford, no Reino Unido.

O BBC Verify questionou o TikTok e a Meta, empresa responsável pelo Facebook e pelo Instagram, se pretendiam adotar medidas similares à da plataforma X, mas as empresas não responderam às perguntas..

Um exemplo típico de vídeo gerado com IA identificado pelo BBC Verify mostra supostos mísseis atingindo a maior cidade israelense, Tel Aviv, enquanto o som de explosões aparece ao fundo.

Esse vídeo apareceu em mais de 300 publicações, que depois foram compartilhadas dezenas de milhares de vezes em diferentes plataformas de redes sociais.

Alguns usuários do X perguntaram ao chatbot de IA da própria plataforma X, o Grok, para perguntar se o vídeo era real ou falso.

Em muitos casos, porém, o Grok erroneamente insiste que o vídeo gerado com IA era real.

Outro vídeo falso, visto dezenas de milhões de vezes, supostamente registra o maior arranha-céu do mundo, o Burj Khalifa, em Dubai, em chamas, enquanto uma multidão corre nos arredores.

Esse vídeo gerado por IA se espalhou na internet em meio ao medo de moradores e turistas em relação a mísseis e drones na cidade dos Emirados Árabes Unidos.

"Vídeos falsos como esses têm um impacto negativo na confiança das pessoas em relação a conteúdos reais e verificados que elas veem na internet e torna muito mais difícil documentar informações verdadeiras", afirma Alimardani.

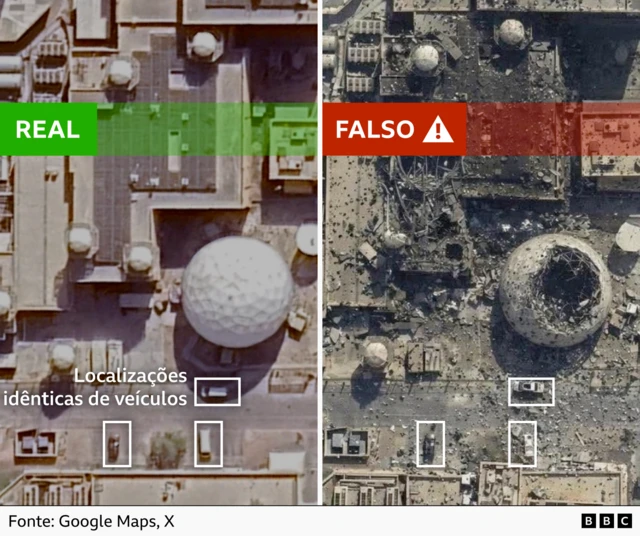

Uma novidade neste conflito analisada pelo BBC Verify é a disseminação de supostas imagens de satélite, que na verdade foram geradas com ferramentas de IA.

O BBC Verify analisou diversos vídeos reais que mostravam ataques iranianos com drones e mísseis contra o quartel-general da Quinta Frota da Marinha dos EUA no Bahrein, no primeiro dia de conflito.

Uma imagem forjada, compartilhada no X pelo jornal iraniano ligado ao governo The Tehran Times, começou a se espalhar no dia seguinte alegando um enorme dano à base americana.

A imagem falsa parece ser baseada em imagem real de satélite da base americana no Bahrein registrada em fevereiro de 2025, e que está acessível ao público.

Segundo uma ferramenta do Google para detecção de marca d'água de ferramentas de IA (SynthID), essa imagem fabricada foi gerada ou editada com uma ferramenta de IA do próprio Google.

Três veículos estão, por exemplo, estacionados exatamente no mesmo lugar na imagem real e na imagem forjada, apesar de as imagens serem datadas com quase um ano de diferença.

Ferramentas de IA do Google, como o gerador de vídeos Veo, fazem parte da crescente lista de plataformas populares de IA, ao lado do Sora (da OpenAI), do Seedance (da ByteDance) e o Grok (do X), entre outras.

"Não há precedentes para o número de ferramentas diferentes que agora estão disponíveis para criar uma ampla leva de manipulações com IA ultrarrealistas", afirma o especialista em IA generativa Henry Ajder.

"Elas nunca foram tão disponíveis, tão fáceis de usar e tão baratas."

Esses fatores também têm levado à ampliação de conteúdos gerados com IA "porque o processo de publicação nas redes sociais agora é praticamente automatizado", afirma Victoire Rio, diretora-executiva da What To Fix, organização sem fins lucrativos que atua no setor de políticas para tecnologia.

O chefe de produto do X disse na última terça-feira (3/2) que "99%" das contas que divulgam vídeos gerados por IA como esses estavam tentando "explorar a monetização" publicando conteúdo capaz de gerar grande engajamento em troca de pagamentos por meio do programa Creator Revenue Sharing (compartilhamento de receita com criadores, em tradução livre) da plataforma.

O X não divulga quantas contas fazem parte do programa nem quanto dinheiro elas podem ganhar.

Mas Graham, da Universidade de Tecnologia de Queensland, estima que o X possa pagar cerca de "US$ 8 a US$ 12 dólares [R$ 40 a R$ 60] por milhão de impressões de usuários verificados".

"Os criadores precisam atingir cinco milhões de impressões orgânicas em três meses, além de ter uma assinatura premium do X, para serem elegíveis", diz Graham.

"Uma vez que você entrou, o conteúdo viral gerado por IA é basicamente uma máquina de fazer dinheiro", afirma. "Eles construíram uma empresa de desinformação definitiva".

O X não respondeu ao nosso pedido de comentário nem às perguntas sobre o programa Creator Revenue Sharing.

Especialistas disseram ao BBC Verify que, embora muitas empresas de redes sociais afirmem estar tentando adaptar seus sistemas de moderação e detecção para lidar com a escala e a velocidade com que conteúdos gerados por IA se espalham, não existe uma solução simples para o problema.

"A questão mais profunda é que a monetização baseada em engajamento e a informação precisa estão fundamentalmente em conflito, e nenhuma plataforma resolveu completamente essa tensão, e talvez nunca resolva", diz Graham.

German (DE)

German (DE)  English (US)

English (US)  Spanish (ES)

Spanish (ES)  French (FR)

French (FR)  Hindi (IN)

Hindi (IN)  Italian (IT)

Italian (IT)  Portuguese (BR)

Portuguese (BR)  Russian (RU)

Russian (RU)  3 meses atrás

53

3 meses atrás

53

/https://i.s3.glbimg.com/v1/AUTH_08fbf48bc0524877943fe86e43087e7a/internal_photos/bs/2026/2/d/ahXI6IRKKsgCfZJLSm1g/unnamed-1-.webp)

:strip_icc()/i.s3.glbimg.com/v1/AUTH_59edd422c0c84a879bd37670ae4f538a/internal_photos/bs/2023/l/g/UvNZinRh2puy1SCdeg8w/cb1b14f2-970b-4f5c-a175-75a6c34ef729.jpg)

/https://i.s3.glbimg.com/v1/AUTH_08fbf48bc0524877943fe86e43087e7a/internal_photos/bs/2026/f/G/gGrBNJRwaydNM9Xc9HNQ/54966404065-a6a099d410-b.jpg)

:strip_icc()/i.s3.glbimg.com/v1/AUTH_08fbf48bc0524877943fe86e43087e7a/internal_photos/bs/2024/o/u/v2hqAIQhAxupABJOskKg/1-captura-de-tela-2024-07-19-185812-39009722.png)

Comentários

Aproveite ao máximo as notícias fazendo login

Entrar Registro